コンテンツ制作現場における生成AIの運用実態とは?リスクと課題の調査結果を報告

コンテンツ制作現場における生成AIの運用実態とは?

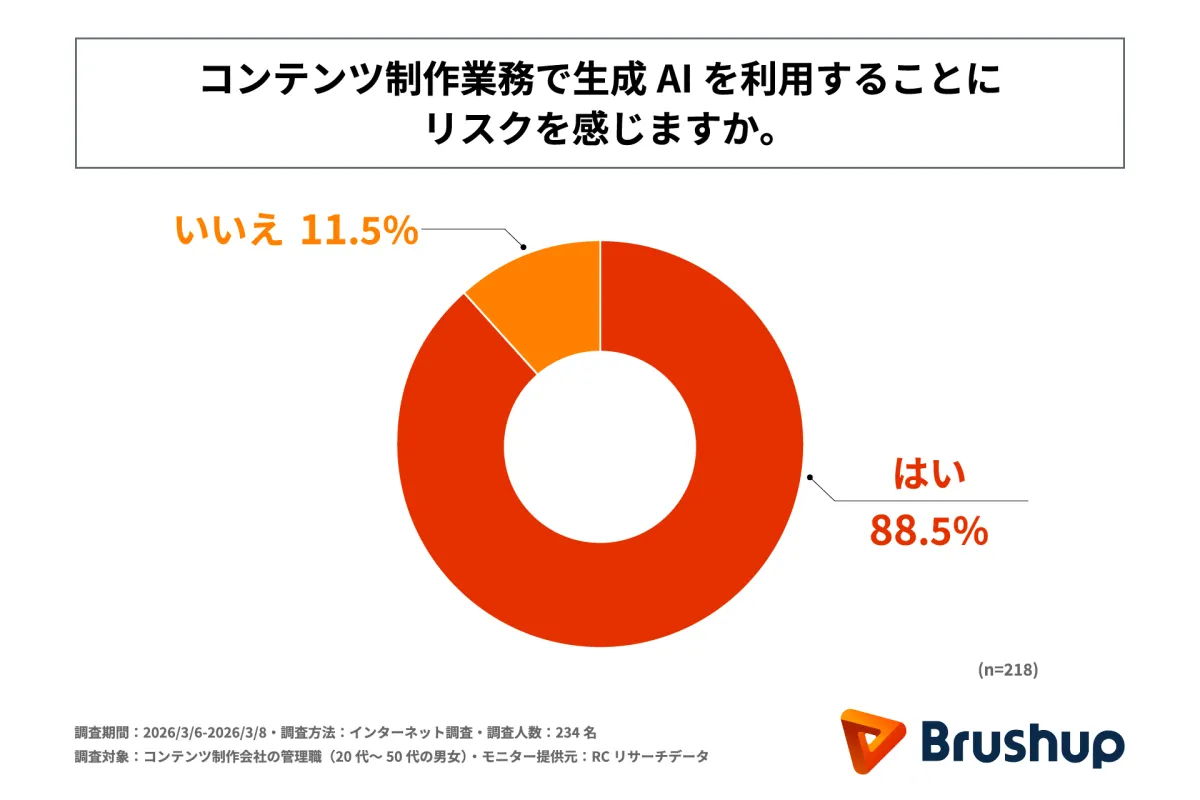

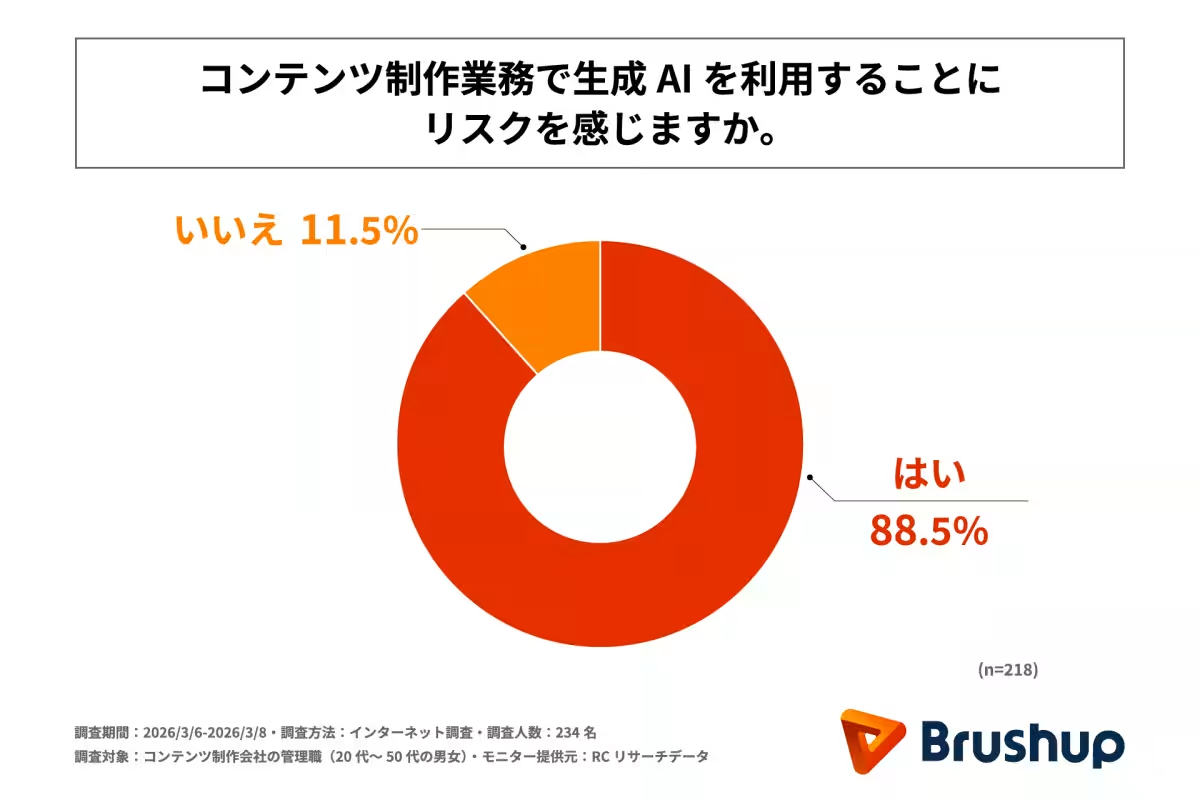

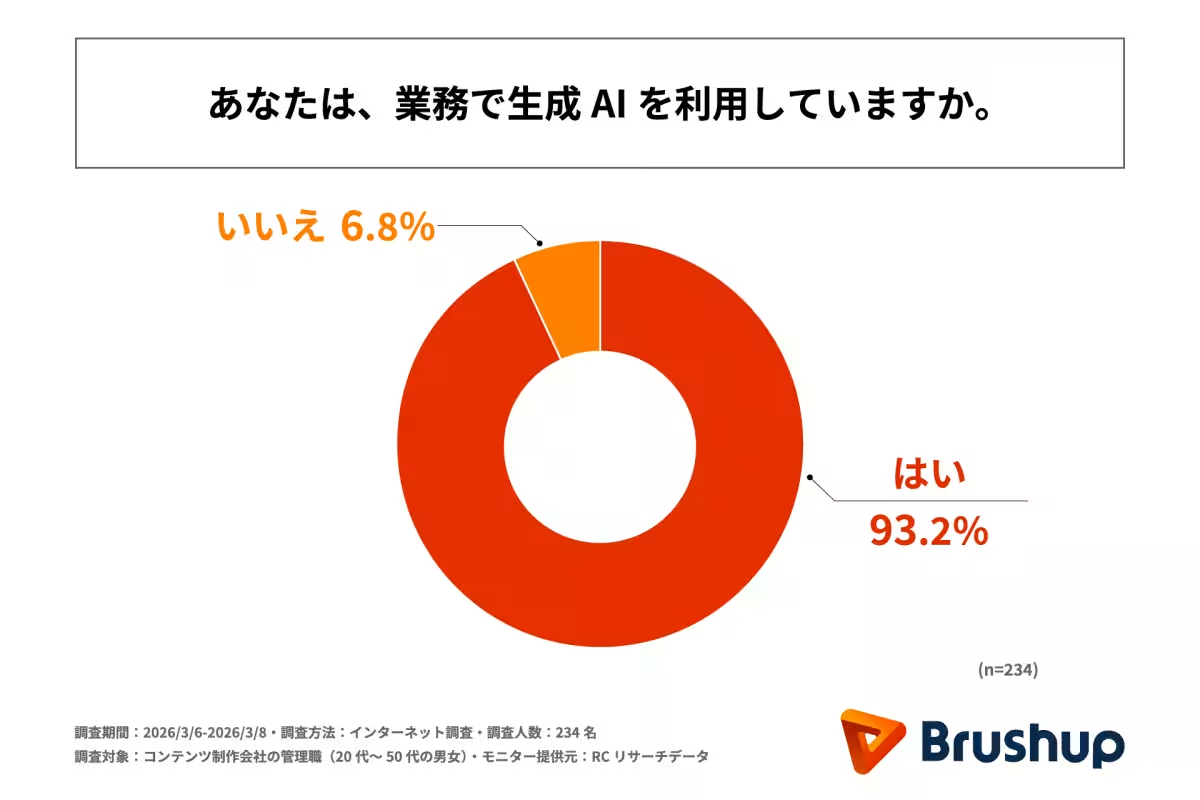

株式会社Brushupが行った「コンテンツ制作現場における生成AI運用体制に関する実態調査」では、コンテンツ制作会社の管理職の約9割が業務で生成AIを利用していることが分かりました。コンテンツ制作が進展する中で生成AIのビジネス活用が急速に進んでおり、その一方でリスク管理の重要性も増しています。本記事では、調査結果から浮かび上がった実態と課題について詳しく解説します。

調査の背景

新年度に向けて、多くの企業が業務効率化やデジタルトランスフォーメーション(DX)を推進しています。その中でも生成AIは、コンテンツ制作の現場でますます重要なツールとなっています。しかし、一方で著作権や情報漏えいなどのリスクが存在し、まだ運用ルールやチェック体制が整っていない現状が懸念されています。

調査結果の概要

- - 利用状況:87.8%の管理職が生成AIを利用

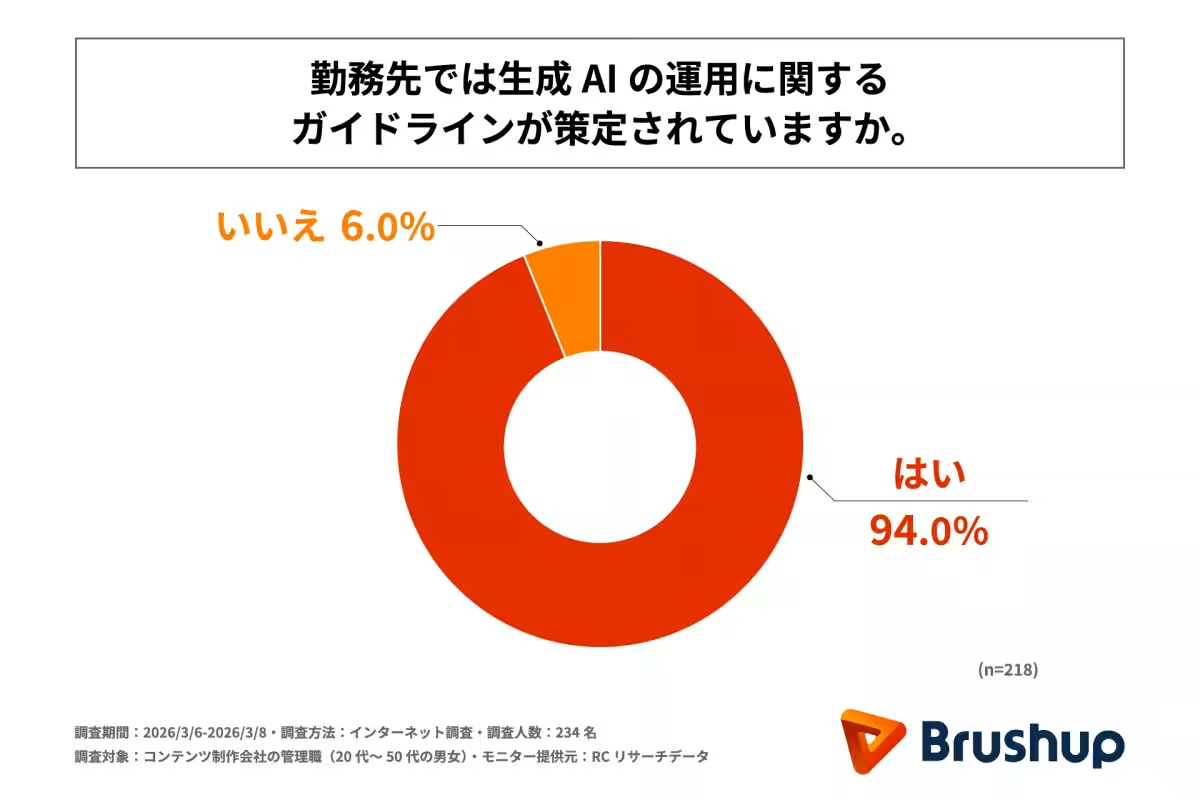

- - ガイドライン:93.2%が運用ガイドラインを策定

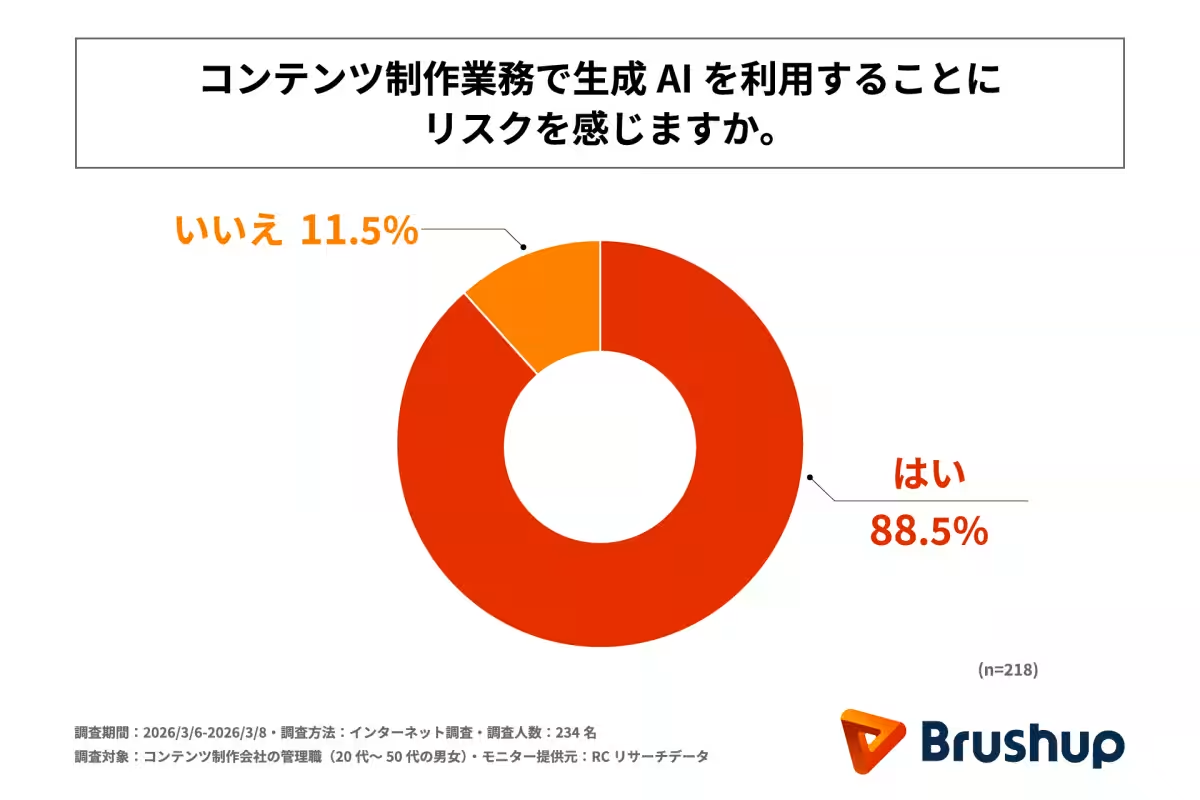

- - リスク感知:88.5%がリスクを感じている

具体的なリスクと課題

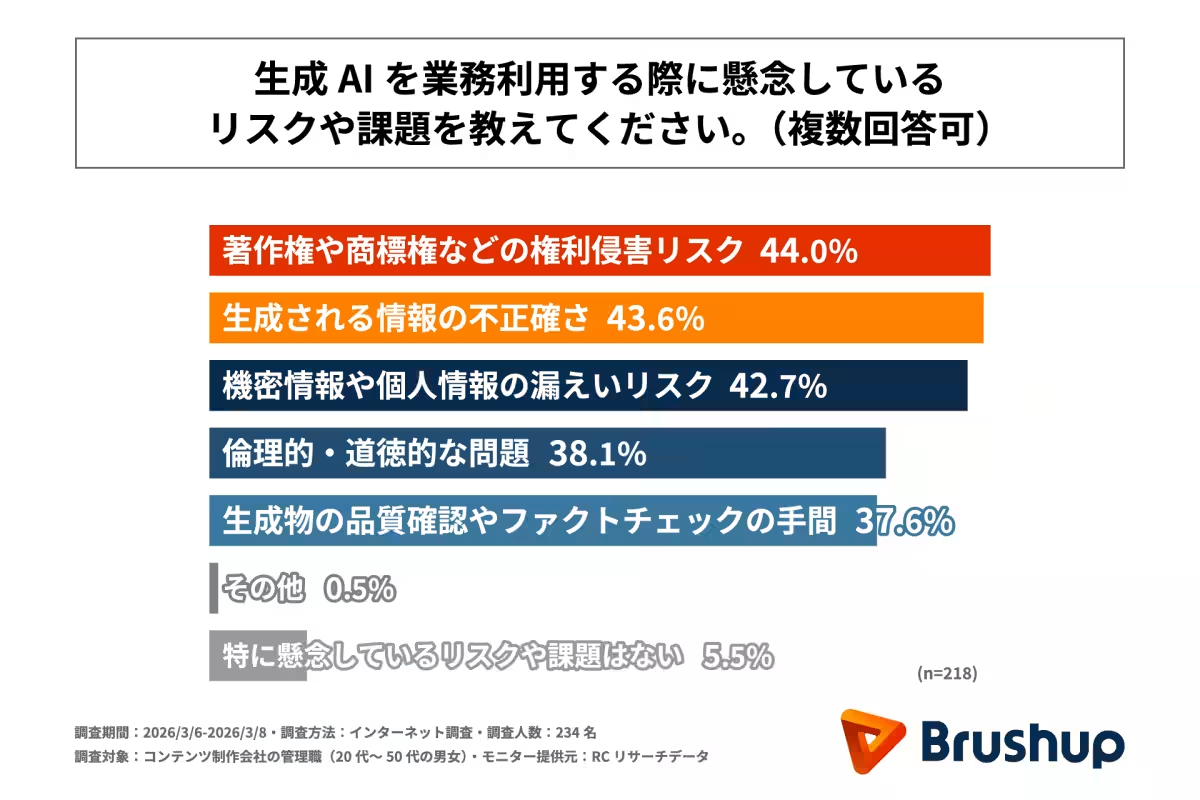

調査の結果、生成AIを業務利用する際に最も懸念されているリスクは次の3つ。

1. 著作権や商標権の侵害(44%)

2. 生成される情報の不正確さ(43.6%)

3. 機密情報や個人情報の漏えい(42.7%)

これらのリスクに対する懸念が、生成AIの導入を考える管理職に影響を与えています。

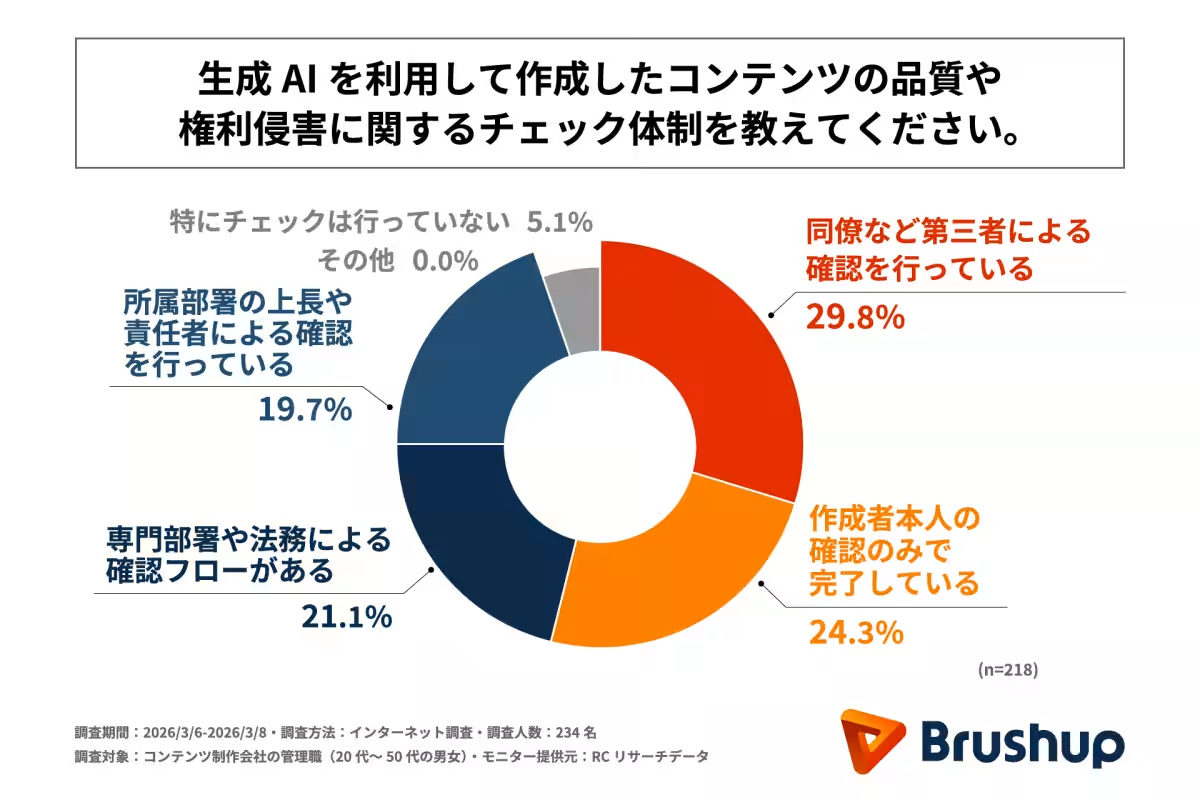

品質チェック体制について

生成AIで制作されたコンテンツの品質や権利侵害に関するチェックについては、約3割の管理職が「制作者本人の確認のみ」または「確認を行っていない」と回答しています。これは、リスク管理体制がまだ十分に整っていないことを示唆しています。

必要な仕組み

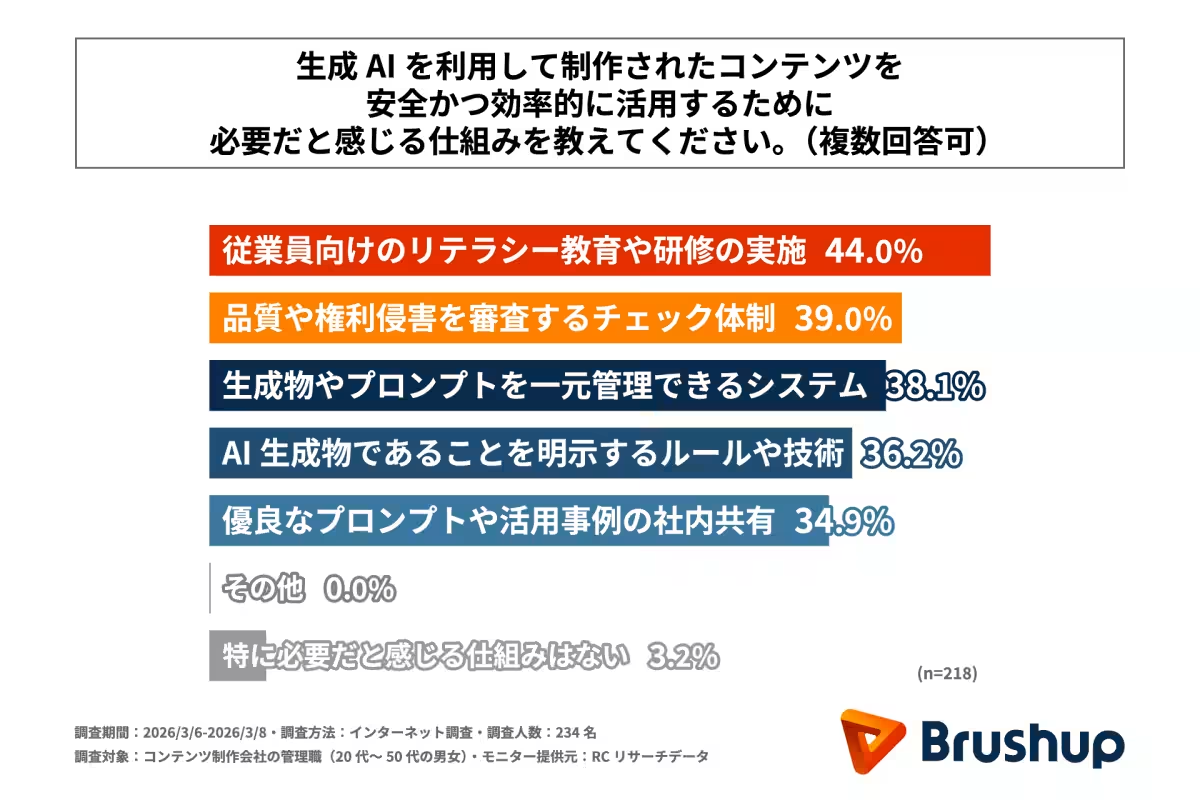

調査では、生成AIで制作されたコンテンツを安全かつ効率的に活用するために必要だと感じる主な仕組みが複数挙げられました。特に重視されているのは以下の2つです。

- - 従業員向けのリテラシー教育や研修(44%)

- - 品質や権利侵害を審査するチェック体制(39%)

まとめ

今回の調査結果から、コンテンツ制作会社の管理職は業務で生成AIを積極的に活用しているものの、その運用にリスクを伴うことを強く認識していることが明らかになりました。今後、生成AIを安全に運用し、業務に役立てるためには、教育とチェック体制の充実化が不可欠です。

このような状況に対応するため、株式会社Brushupが提供する「Brushup」プラットフォームが注目されています。このプラットフォームは、チームでの品質管理を支援し、安全な制作環境の構築を可能にします。興味がある方は、ぜひ公式サイトを訪れて、最新の情報をご確認ください。

トピックス(その他)

【記事の利用について】

タイトルと記事文章は、記事のあるページにリンクを張っていただければ、無料で利用できます。

※画像は、利用できませんのでご注意ください。

【リンクついて】

リンクフリーです。